(1)

2016 年一月底,人工智能的研究领域,发生了两件大事.

先是一月二十四号,MIT 的教授,人工智能研究的先驱者,Marvin Minsky 去世,享年89岁.

三天之后,谷歌在自然杂志上正式公开发表论文,宣布其以深度学习技术为基础的电脑程序 AlphaGo, 在2015年十月,连续五局击败欧洲冠军,职业二段樊辉.

这是第一次机器击败职业围棋选手. 距离97年IBM电脑击败国际象棋世界冠军,一晃近二十年了.

极具讽刺意义的是, Minsky 教授,一直不看好深度学习的概念. 他曾在1969年出版了 Perceptron (感知器) 一书,指出了神经网络技术 (就是深度学习的前身)的局限性. 这本书直接导致了神经网络研究的将近二十年的长期低潮.

神经网络研究的历史,是怎样的?

深度学习有多深? 学了究竟有几分?

(2)

人工智能研究的方向之一, 是以所谓 "专家系统" 为代表的, 用大量 "如果-就" (If - Then) 规则定义的, 自上而下的思路.

人工神经网络 ( Artifical Neural Network),标志着另外一种,自下而上的思路.

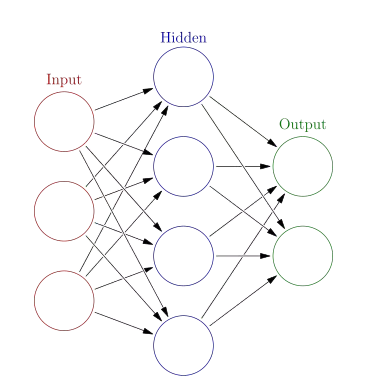

神经网络没有一个严格的正式定义. 它的基本特点, 是试图模仿大脑的神经元之间传递,处理信息的模式.

一个计算模型,要划分为神经网络,通常需要大量彼此连接的节点 (也称 '神经元'),并且具备两个特性:

每个神经元, 通过某种特定的输出函数 (也叫激励函数 activation function),计算处理来自其它相邻神经元的加权输入值.

神经元之间的信息传递的强度,用所谓加权值来定义,算法会不断自我学习,调整这个加权值.

在此基础上,神经网络的计算模型, 依靠大量的数据来训练, 还需要:

成本函数 (cost function)

用来定量评估根据特定输入值, 计算出来的输出结果,离正确值有多远,结果有多靠谱.

学习的算法 ( learning algorithm )

这是根据成本函数的结果, 自学, 纠错, 最快地找到神经元之间最优化的加权值.

用小明,小红和隔壁老王们都可以听懂的语言来解释, 神经网络算法的核心就是

计算, 连接, 评估, 纠错, 疯狂培训

随着神经网络研究的不断变迁,其计算特点 ,和传统的生物神经元的连接模型渐渐脱钩.

但是它保留的精髓是: 非线性,分布式, 并行计算, 自适应, 自组织.

(3)

神经网络作为一个计算模型的理论,1943年最初由科学家 Warren McCulloch 和Walter Pitts 提出.

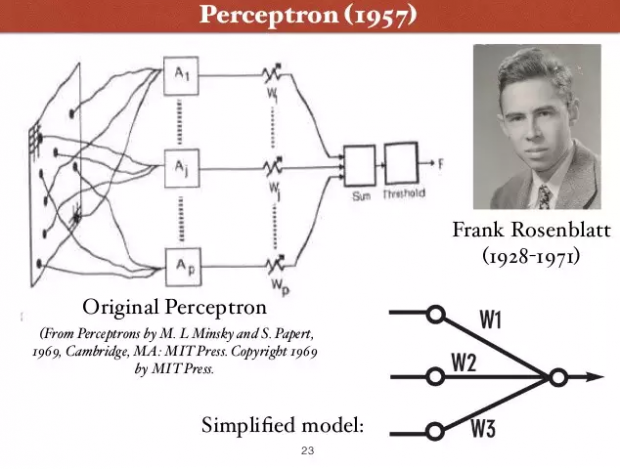

康内尔大学教授 Frank Rosenblatt 1957年提出的"感知器" (Perceptron),是第一个用算法来精确定义神经网络, 第一个具有自组织自学习能力的数学模型,是日后许多新的神经网络模型的始祖.

Rosenblatt 乐观地预测,感知器最终可以 "学习,做决定,翻译语言". 感知器的技术,六十年代一度走红,美国海军曾出资支持这个技术的研究, 期望它 "以后可以自己走, 说话, 看, 读, 自我复制, 甚至拥有自我意识".

Rosenblatt 和 Minsky 实际上是间隔一级的高中校友.但是六十年代, 两个人在感知器的问题上,展开了长时间的激辩. Rosenblatt 认为感应器将无所不能, Minsky 则认为它应用有限.

1969 年, Marvin Minsky 和 Seymour Papert 出版了新书: "感知器: 计算几何简介". 书中论证了感知器模型的两个关键问题:

第一, 单层的神经网络无法解决不可线性分割的问题, 典型例子如异或门, XOR Circuit ( 通俗地说, 异或门就是: 两个输入如果是异性恋,输出为一. 两个输入如果是同性恋,输出为零 )

第二, 更致命的问题是,当时的电脑完全没有能力完成神经网络模型所需要的超大的计算量.

此后的十几年,以神经网络为基础的人工智能研究进入低潮,相关项目长期无法得到政府经费支持,这段时间被称为业界的核冬天.

Rosenblatt 自己则没有见证日后神经网络研究的复兴. 1971年他43岁生日时,不幸在海上开船时因为事故而丧生.

(未完待续)

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号