(1)

2009年, 一群在普林斯顿大学计算机系的华人学者, (第一作者为 Jia Deng )发表了论文 "ImageNet: A large scale hierarchical image database), 宣布建立了第一个超大型图像数据库,供计算机视觉研究者使用.

这个数据库建立之初,包含了三百二十万个图像. 它的目的, 是要把英文里的八万个名词,每个词收集五百到一千个高清图片,存放到数据库里.最终达到五千万以上的图像.

2010 年,以 ImageNet 为基础的大型图像识别竞赛, ImageNet Large Scale Visual Recognition Challenge 2010 (ILSVRC2010) 第一次举办.

竞赛最初的规则是,以数据库内一百二十万个图像为训练样本.这些图像从属于一千多个不同的类别, 都被手工标志.

经过培训过的程序,再用于五万个测试图像评估,看看它对图像的分类是否准确.

2010年竞赛的第一名, 是NEC 和伊利诺伊大学香槟分校的联合团队,用支持向量机 (SVM) 的技术,识别分类的错误率为 28% (计算机会对图像的分类,答出最有可能的头五个类别,所谓 top five category, 如果正确答案都不在里面,即为错误)

2011年竞赛的冠军, 用所谓 Fisher Vector 的计算方法 (和支持向量机技术类似), 将错误率降到了 25.7%.

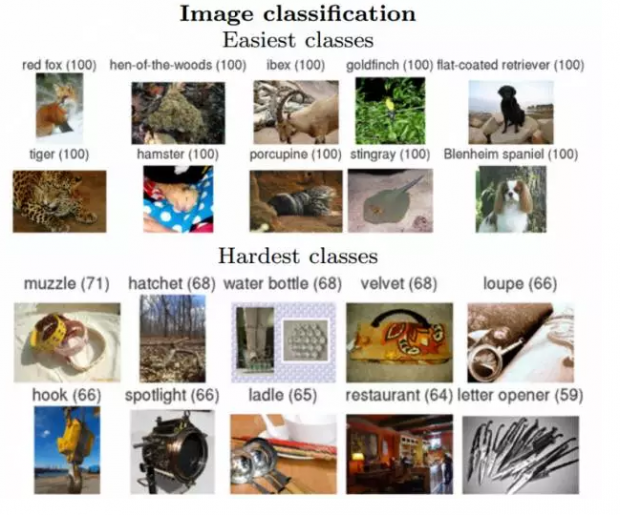

其实这个分类问题, 对于普通人来说, 也不是想象中那么容易. 如上图, 最容易分类的包括老虎,狐狸,豪猪之类的动物. 较难分类的有餐馆,聚光灯, 放大镜之类的物件.

(2)

2012年,Hinton 教授和他的两个研究生 Alex Krizhevsky, Illya Sutskever 将深度学习的最新技术用到 ImageNet 的问题上.

(下图左一为 Suskever, 中为 Krizhevsky, 右一为 Hinton)

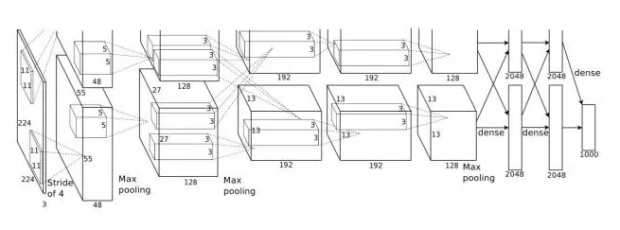

他们的模型,是一个总共八层的卷积神经网络,有六十五万个神经元,六千万个自由参数.

你也许还记得严乐春老师, 使用卷积神经网络的技术, 八十年代末, 在手写数字识别上获得突破. 但是后来,在通用的图像识别问题上, 支持向量机 (SVM) 的技术逐渐成为业界的主流.

二十多年后, 仰仗着计算速度, 数据量和算法的迅速进步,卷积神经网络又卷土重来了.

这个神经网络, 使用了前面两篇文章介绍过的, 丢弃 (Dropout) 算法, 和修正线性单元 (RELU)的激励函数.

Hintong 教授的团队, 使用了 两个 Nvidia 的 GTX 580 CPU (内存 3GB, 计算速度 1.6 TFLOPS), 让程序接受一百二十万个图像训练, 花了接近六天时间.

经过训练的模型,面对十五万个测试图像时,预测的头五个类别的错误率只有 15.3%, 在2012年 ImageNet 的竞赛, 三十个团队的测试结果中, 稳居第一.

排名第二的来自日本团队的模型,相应的错误率则高达 26.2%.

所有其他团队, 采用的都是流行将近二十年的的支持向量机的技术. 但是这一次, 毫无疑义的,被神经网络的技术彻底超越了.

2012年十月十三日, 当竞赛结果公布后,学术界沸腾了.

这是神经网络二十多年来, 第一次, 在图像识别领域, 毫无疑义的, 大幅度挫败了别的技术.

(3)

多年后回头看, 2012年十月十三日, 也许是人工智能技术突破的一个转折点.

但此刻媒体的注意力, 是在次日, 十月十四日, 奥地利冒险家 Baumgartner 在美国的新墨西哥州, 创造了人类从三万八千米的高空, 自由落体安全着陆的新纪录.

ImageNet 竞赛结果的公布, 对于深度学习, 对于人工智能, 对于人类的未来, 也许可用丘吉尔的一句话总结:

"这不是结尾. 这连结尾的开头都算不上. 但, 这也许是,开头的结尾."

(Now this is not the end. It is not even the beginning of the end. But it is, perhaps, the end of the beginning.)

(未完待续)

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号